AI芯片发展历程与新动向 硬件革新与软件生态协同演进

人工智能芯片作为现代计算体系的核心组件,其发展历程与计算机硬件架构、软件算法及周边设备的演进密不可分。从早期的概念萌芽到如今的多元化应用,AI芯片正以前所未有的速度重塑技术边界。

一、AI芯片发展历程

1. 概念萌芽期(20世纪80-90年代)

受人工神经网络理论启发,学界开始探索专用硬件加速方案。这一时期受限于半导体工艺与算法成熟度,多数研究停留在实验室阶段,通用CPU仍承担主要计算任务。

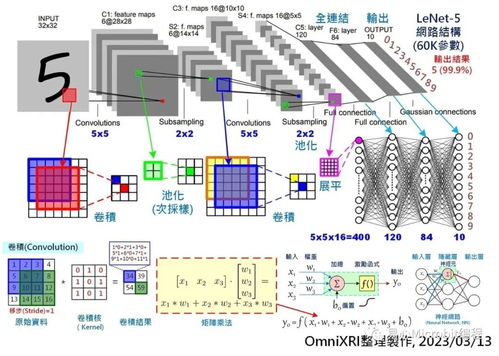

2. 专用架构兴起(2000-2010年)

随着深度学习算法突破,GPU凭借并行计算优势成为AI训练主力。英伟达2006年推出CUDA架构,开创了软硬件协同优化先河。同期出现FPGA在特定场景的部署案例,如微软在Bing搜索中的应用。

3. 爆发式创新阶段(2011-2020年)

谷歌2016年发布TPU引发行业震动,专用ASIC芯片展现能效优势。寒武纪、地平线等企业推出端侧推理芯片,边缘计算需求驱动架构创新。这一时期形成GPU、FPGA、ASIC三足鼎立格局,内存带宽与计算密度成为竞争焦点。

二、最新技术趋势

1. 存算一体架构突破

通过模拟人脑突触工作机制,忆阻器、相变存储器等新型器件实现存储与计算融合,有效克服冯·诺依曼瓶颈。清华大学研发的存算一体芯片在能效比上提升超两个数量级。

2. 光电计算芯片实用化

Lightmatter、曦智科技等企业将光波导技术与深度学习结合,利用光子替代电子进行矩阵运算,在自然语言处理任务中实现毫秒级延迟。

3. 软硬件协同设计深化

PyTorch 2.0与TensorFlow Lite等框架推出编译器级优化,支持芯片指令集自动匹配。英伟达Hopper架构集成Transformer引擎,针对大模型实现动态精度切换。

4. 异构集成技术应用

通过Chiplet、3D堆叠等先进封装技术,将存储、计算、通信模块集成于单一封装。AMD MI300X采用chiplet设计,晶体管内密度提升至1530亿个。

三、周边设备协同演进

1. 互联标准升级

CXL 3.0协议实现设备间缓存一致性,支持AI训练集群的万卡级互联。超高速光模块推动数据中心内800Gbps传输成为标配。

2. 冷却系统革新

浸没式液冷技术在GPT-4等大模型训练集群中普及,热传导效率较风冷提升50倍。微流道冷却芯片实现器件级精准温控。

3. 能源管理智能化

数字孪生技术应用于数据中心能耗建模,Nvidia DGX H100系统集成智能功率分配模块,动态调节频率可节省30%能耗。

四、未来挑战与机遇

当前AI芯片发展仍面临三大挑战:冯·诺依曼瓶颈的根治方案尚未成熟、先进制程逼近物理极限、软硬件生态碎片化。神经形态计算、量子-经典混合架构等方向已显现突破潜力。随着各国投入超千亿美元研发资金,预计到2028年全球AI芯片市场将突破千亿美元规模,最终实现从「专用加速」到「通用智能」的范式转移。

如若转载,请注明出处:http://www.scrd365.com/product/27.html

更新时间:2026-04-20 07:49:01